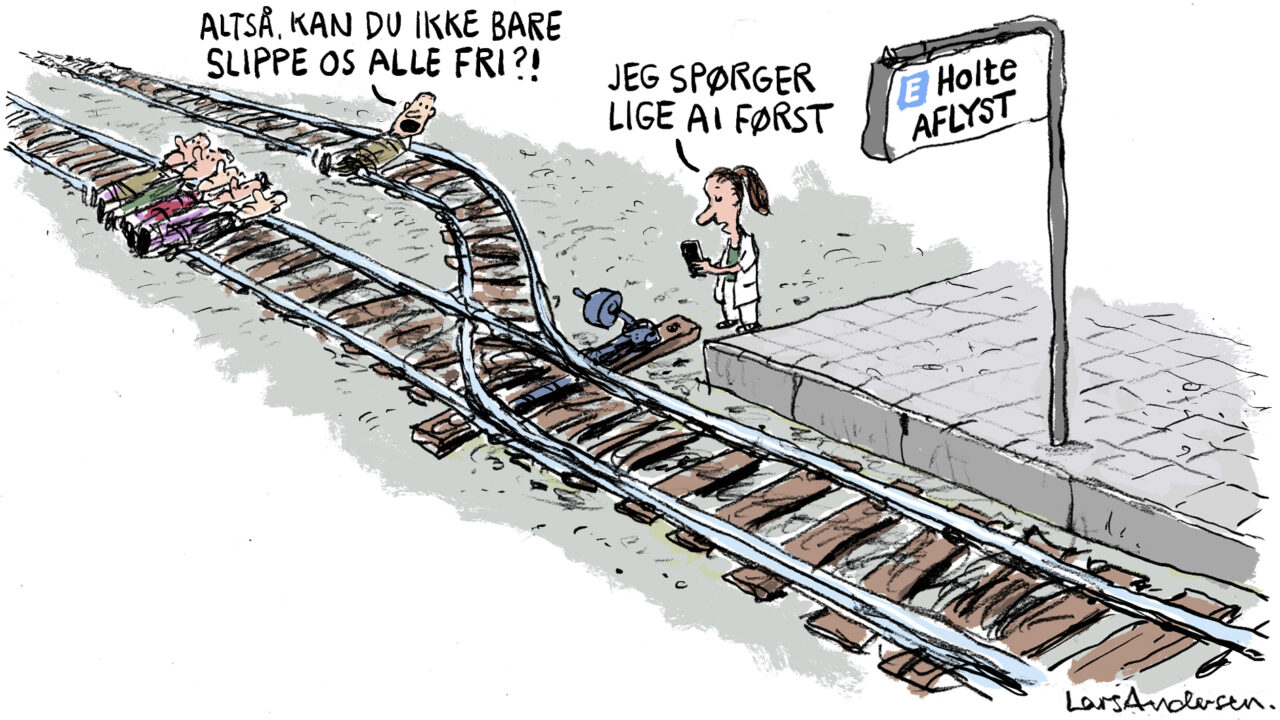

Der findes få tankeeksperimenter, som udfordrer vores moral og ansvarsfølelse så meget som The Trolley Problem. Eksperimentet er tænkt første gang i 1967 af filosoffen Philippa Foot og går ud på, at en sporvogn er på vej mod fem mennesker, der ligger bundet fast på sporet. Du står ved en sporskiftearm. Hvis du trækker i den, redder du de fem – men omdirigerer vognen, kører sporvognen hen mod én person, som så dør.

Hvad vælger du? Der findes intet rigtigt svar. Kun et valg. Måske en følelse – og en forklarende undskyldning.

Men hvad hvis det ikke er dig, der vælger? Hvad hvis det er en AI?

AI skal være perfekt, selvom vi ved, at vi selv er ingen af delene

Det spørgsmål nærmer vi os i sundhedsvæsenet. Det gælder ikke kun i krig, hvor rammerne måske er bredere for brugen af AI, men også i den daglige drift af vores fælles sundhedsvæsen. Når kunstig intelligens prioriterer ventelister, diagnosticerer hurtigere end læger eller foreslår behandling, som sparer liv, men også samtidig forårsager prioriteringer, der kan være, eller vurderes som fejl.

Fejl, vi ikke ville have accepteret, hvis det var et menneske, der begik dem. Eller måske netop kun accepterede, fordi det var et menneske.

Vi accepterer jo, at mennesker er biasbærende, ufuldkomne, overconfidente og til tider arrogante. Vi har lært at tilgive hinanden. At forstå den vanskelige kliniske kontekst, at undskylde med tidspres, træthed, kompleksitet, ufuldstændig viden – og det er godt og nødvendigt.

Men vi kræver af AI, at den er biasfri, etisk ren, gennemsigtig og forklarlig. AI skal være perfekt, selvom vi ved, at vi selv er ingen af delene.

Og her kommer det næste dilemma: Hvad nu, hvis det viser sig, at en veltrænet AI faktisk træffer bedre beslutninger end vi læger – selv når den begår fejl?

Er det nok? Er det bedre at redde 95 ud af 100 med AI, hvis vi stadig ikke kan forklare, hvorfor den 96. døde? Er 95 bedre end de 93 eller 94, vi måske ville redde uden AI? Eller kræver vi fejlfrihed, selv hvis det betyder, at færre overlever? Hvornår er bedre nok?

Er vi villige til at give magten fra os, hvis resultaterne samlet set er bedre? Eller kræver vi stadig, at der sidder et menneske ved sporskiftet, så vi har nogen at kunne skyde skylden på eller tilgive?

Når vi beder AI om at løse ‘The Trolley Problem’, skal vi så ikke også finde ud af, om vi er klar til at tilgive den, ligesom vi forventer at kunne tilgive os selv og hinanden?