Forestil dig en læge med en hammer i hånden. Ikke en fysisk én af slagsen, men et digitalt præcisionsværktøj i form af kunstig intelligens. Rundt om hende ligger sømmene: de utallige dokumentationsopgaver, konsultationer, attester, henvisninger og emails, som hun hver dag skal slå på plads. Men i stedet for at arbejde effektivt, står hun stille – for ingen har endnu sagt, at hun må bruge hammeren.

Hammeren kunne i dette tilfælde være AI-chatbots til støtte i hverdagen eller AI-tale-til-tekst værktøjer, hvor vi det seneste år har set en håndfuld nye nordiske udbydere få meget vind i sejlene. Af en enkelt årsag: De virker ekstremt godt!

Sådan er virkeligheden for mange praktiserende læger, der i dag oplever stigende udbrændthed og administrativt pres samtidig med, at teknologien til at aflaste os står klar – men er uanvendt.

Trivselsundersøgelsen fra Forskningsenheden i Almen Praksis i Aarhus taler sit tydelige sprog: 48 pct. af landets praktiserende læger viser tegn på moderat udbrændthed, og 14 pct. har en alvorlig grad. Det skyldes bl.a. administrative byrder – herunder arbejdet med komplekse patientjournaler og forløb samt omfattende kommunale attester.

En assistent til dokumentation

Mange af de omtalte løsninger er nye og opdateres mange gange årligt, hvorfor der ikke foreligger meget videnskabelig evidens for effekt og sikkerhed af de nyeste versioner af løsningerne.

Dog viser et studie at tale-til-tekst-teknologi kan gøre en markant forskel, hvor talegenkendelse i journalsystemet medførte højere dokumentationskvalitet og øget lægetilfredshed. Lægerne blev ikke erstattet – de blev hjulpet.

Behovet for en ansvarlig og operationel vurdering er ikke om ti år. Det er ikke engang om ét år. Det er nu

Der er naturligvis ikke tale om, at vi vil overlade det kliniske ansvar til en maskine. Det er blot et sparringsværktøj, og en assistent til at løfte den opgave, som dokumentation i dag er blevet.

Den helt store udfordring er, at de praktiserende læger, helt forståeligt, er bekymrede for at bruge disse værktøjer af datasikkerhedsårsager. Desværre er der ikke hjælp at hente, da Lægeforeningen og eksempelvis de Praktiserende Lægers Organisation (PLO) ikke har ‘ressourcerne’ til at vejlede medlemmerne i god og sikker brug. For der er bestemt også en risiko for fejl og misbrug, ligesom der er et hav af opgaver vi ikke kan bruge f.eks. chatbotten til.

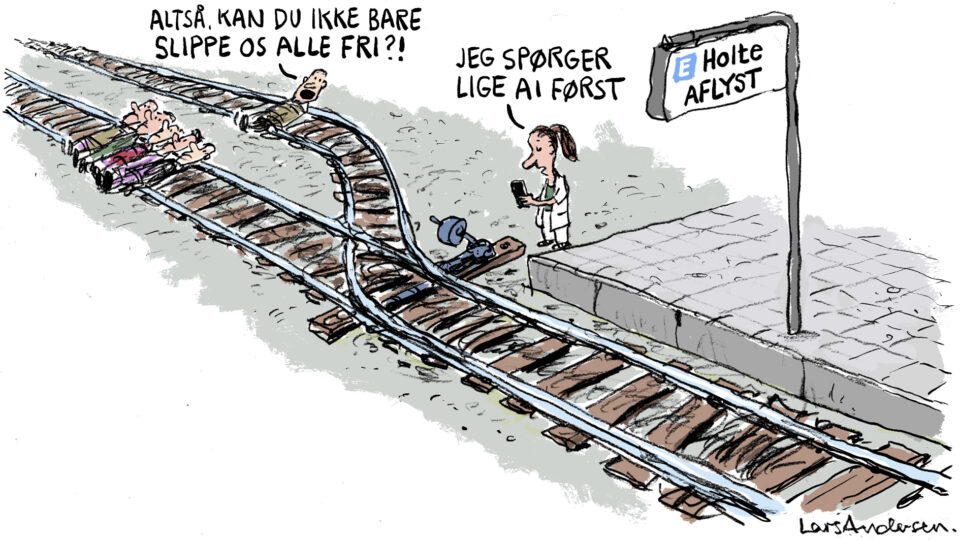

Simpelthen fordi ingen tør at lægge hånden på kogepladen og vurdere hvordan det kan bruges lovligt og sikkert. Der findes ingen instans, ingen myndighed, ingen region eller faglig organisation, som i dag tør gå ud og sige: Her er en måde, det kan gøres ansvarligt på.

Resultatet? Vi lader teknologien ligge og går rundt med hammeren i hånden uden at bruge den.

Juridisk vurdering mangler

Datatilsynet har i 2025 generativ AI i sundhed som et fokusområde, dog uden at specificere det nærmere. Det er naturligvis aktuelt og vigtigt. For brugen indebærer reelle risici for patientdata, fejl og fortrolighed.

Men mens tilsynet kigger fremad og undersøger, om vi bør bekymre os, er lægerne i færd med at knække under byrden her og nu. Det er derfor ikke nok, at der kommer en juridisk vurdering ‘på sigt’. Behovet for en ansvarlig og operationel vurdering er ikke om ti år. Det er ikke engang om ét år. Det er nu.

I dag er vi mange, der går rundt med en hammer i hånden og ser på sømmene. Vi ved, at vi kunne arbejde mere effektivt og målrettet – med patientens data og lægens vurdering i centrum – hvis nogen turde definere rammerne. Ikke for at fjerne ansvar, men for at sikre, at vi overhovedet tør tage værktøjet i brug.

Derfor: Er der en jurist til stede?